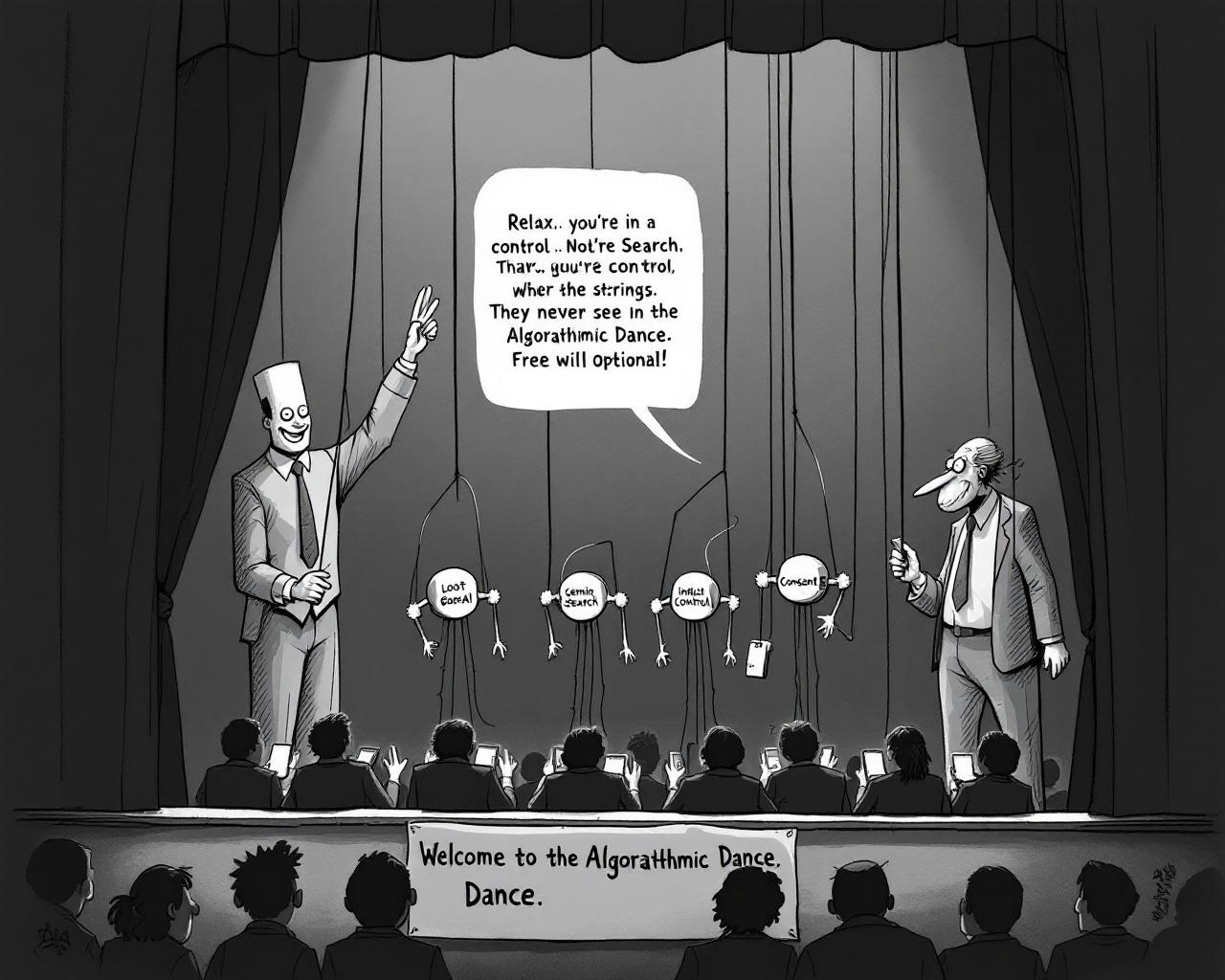

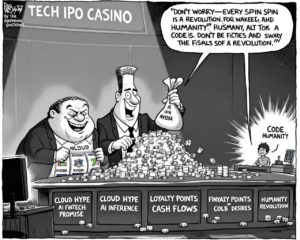

Et si la liberté du joueur n’était plus qu’une illusion, savamment entretenue par une danse algorithmique orchestrée aussi bien par les géants du jeu mobile que par ceux de la finance et de la recherche? Tandis que l’industrie du jeu mobile fait l’objet d’enquêtes musclées pour manipulation psychologique et économiques douteuses, Google et OpenAI transforment la recherche en un terrain de jeu exclusivement réservé à leurs IA, tandis qu’Intuit injecte de l’intelligence artificielle dans nos carnets bancaires sous couvert de progrès. À l’heure où chaque domaine de notre expérience numérique semble piloté selon des logiques d’optimisation opaque et d’enfermement algorithmique, il devient urgent de questionner la frontière réelle entre l’assistance bienveillante et l’asservissement persuasif.

Le point commun ? L’invisibilité de la manipulation : insérer subrepticement des achats dans un shooter mobile pour enfants relève du même art que camoufler d’habiles biais dans les résultats de recherche produits par un agent conversationnel, ou dissimuler les dérives de l’IA qui s’immisce dans la gestion de nos finances. Qu’il s’agisse de loot boxes, de réponses “factuelles” produites par Gemini Deep Research, ou de conseils personnalisés dans QuickBooks via ChatGPT, toute l’astuce consiste à faire passer la contrainte pour une opportunité, à maquiller la dépendance pour un service. Curieuse époque où la transparence n’est plus exigée mais monétisée, transformant la confiance naïve en risque programmé pour le consommateur piégé dans la boucle de feedback des GAFAM.

Le bal des promesses se joue de la vigilance réglementaire aussi bien que du sens critique de l’utilisateur : Microsoft temporise alors que l’Italie attire la lumière sur les mécanismes addictifs du free-to-play, Google fabrique ses propres benchmarks pour prouver la suprématie de ses modèles sur ceux d’OpenAI, Intuit jure que les hallucinations de l’IA seront “encadrées” – en oubliant de préciser sous quelle juridiction tombera la responsabilité d’une faillite liée à un mauvais conseil automatisé. L’ascenseur émotionnel est constant : derrière chaque innovation vantée comme une prouesse, jamais une évaluation sérieuse des conséquences sociales, éthiques ou financières. Qui protège l’utilisateur du biais d’un modèle, de la faille dans les garde-fous, ou du trop-plein d’efficacité prédatrice ?

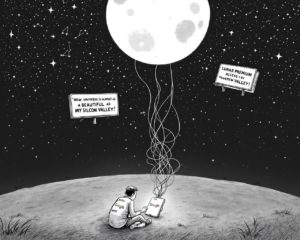

Un monde piloté par l’IA s’exhibe comme une avancée, mais se vit souvent comme une dépossession sous assistance algorithmique.

Que l’on clique pour obtenir un skin légendaire, une information “fiable”, ou une simulation de remboursement fiscal, partout rôde cette même logique : réduire le libre-arbitre à une illusion d’autonomie, verrouillée par une architecture persuasive. L’ouverture à la concurrence ou à l’innovation ne change rien si la liberté de choix disparaît dans le brouillard d’interfaces trop simplifiées, de tutoriels gamifiés et de “consentements” arrachés. Même les partenariats historiques, à l’image d’Intuit et OpenAI, ne sont que la confirmation du même paradigme : la technologie avance, la responsabilité recule.

Difficile d’ignorer, au fil de cette avalanche de discours sur l’innovation, que l’ultime prouesse est peut-être d’être devenu l’acteur passif, l’expérience elle-même transformée en champ d’expérimentation pour des IA de plus en plus autonomes, voire autarciques. Reste à savoir si nous, consommateurs et citoyens, choisirons d’admirer béatement la magie – ou d’arracher enfin, à coups de réglementation et d’éveil critique, les ficelles qui nous pendent au bout des doigts.