« C’est décidé, en 2026, l’intelligence artificielle sera enfin utile – ou disparaîtra, avalée par son propre hype-cycle, dans un silence de GPU en recalcitrance. » on nous l’assure depuis les feux d’artifice du deep learning. Après l’année du « vibe check » de l’IA et l’avènement de Small Language Models optimisés, l’écosystème tech se réveille groggy, avec la question sur toutes les lèvres : pourquoi continuer de gonfler les modèles et vider les data-centers, alors qu’on peut simplement fournir la bonne réponse, au bon moment, dans le bon subreddit – et tant qu’à faire, inciter au shopping impulsif ?

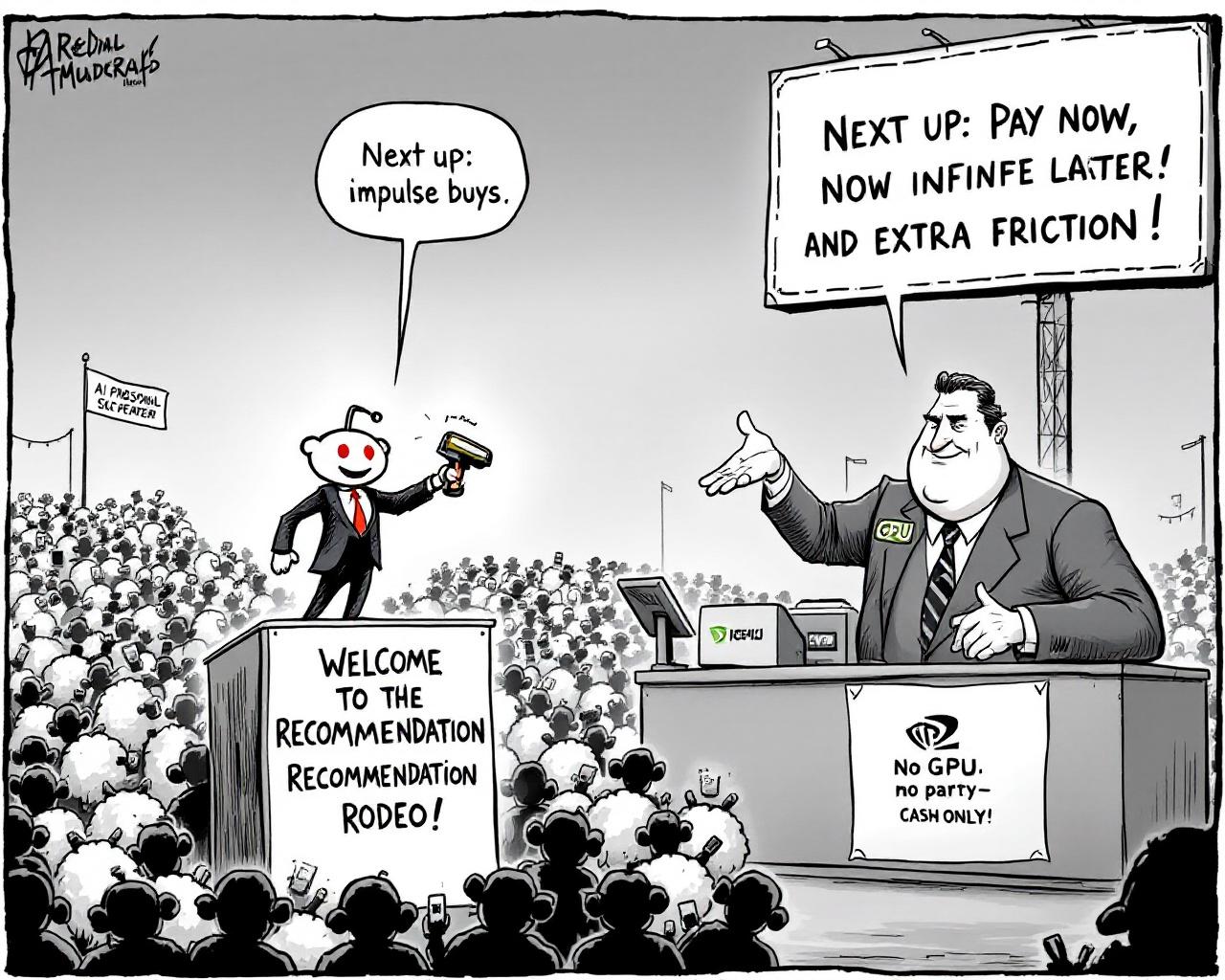

Car pendant que les chercheurs réclament la sobriété et l’architecture ajustée, Reddit rêve de transformer ses meutes d’internautes passionnés en agences de personal shoppers dopés à l’IA. Fini les memecoins, place à la monétisation directe du scroll de vos insomnies : entre deux débats sur la pertinence du dernier world-model, surgit un carrousel de produits recommandés, propulsé par l’intelligence domestiquée et la magie communautaire. L’IA industrielle se fait a minima, l’IA conversationnelle se fait cash-flow. La boucle est bouclée : la recherche du sens technique retombe, une fois de plus, sur la nécessité de vendre, de facturer, et surtout de ne pas laisser Amazon ou Insta garder le gâteau publicitaire.

Mais dans cette frénésie de l’intégration intelligente, un (gros) caillou se glisse dans l’engrenage : les GPU. Pas n’importe lesquels, les sacro-saints H200 de Nvidia, vendus à prix d’or sur le marché chinois, avec, cette année, le paiement 100% comptant au moment de la signature. Oubliez la flexibilité californienne : la géopolitique du silicium ne se chipote plus, elle s’impose net, cash, sécurité d’État et quotas par lots de 5,5 milliards de dollars rayés des stocks en cas de faux pas diplomatique. Pendant que Reddit s’essaie à l’IA personnalisée à coût contenu, Nvidia invente le « Pay now, hope later ». Même schéma : la valeur, c’est la friction. Acheter un chipset ou un casque sans frisson, c’est dépassé.

La technologie de demain sera celle qui sait vendre, mais aussi convaincre – sans jamais perdre la main sur le portefeuille, ni sur la conversation.

Ce n’est donc pas de progrès technique dont il est question, mais de contrôle de l’infrastructure : qui anime les conversations déterminant les choix d’achat, qui fait tourner les serveurs d’IA de demain, qui verrouille (ou libère) la chaîne de valeur, de la puce au panier ? Derrière les discours sur l’utilité nouvelle de l’IA se joue la bataille sourde de la normalisation (bonjour, le « MCP » de Anthropic, alias « l’USB-C de l’IA »), la dictature des middlewares, la transformation de simples utilisateurs en bétail à recommandations. L’Intelligence se niche dans la fluidité des workflows ; la domination, dans le paiement à l’instant, l’emprunt sous caution, le GPU sous embargo.

De ce grand bal algorithmique sort une évidence : que vous soyez petite startup hantée par les SLM ou géant du cloud en mal de H200, votre vraie bataille en 2026 sera de rester à la fois pertinent et liquide, conversationnel et insaisissable. Peu importe le secteur : ceux qui survivront ne seront pas les plus « innovants » mais les plus capables de transformer chaque échange, chaque clic, chaque paiement en une boucle attention-monnaie optimisée par leur propre IA. Voilà pourquoi le shopping sur Reddit n’est qu’un banc d’essai, et la nouvelle politique de Nvidia un mètre étalon : dans la Silicon Valley, la vraie « intelligence », c’est la maîtrise de la friction – et qui sait, au prochain vibe check, de la battre… ou de l’encaisser mieux que les autres.