On croyait que la frontière ultime, c’était l’espace. Mais à y regarder de plus près dans l’arène tech de cette semaine, il s’agirait surtout de repousser l’horizon du “contrôle” — contrôle de l’information, des flux financiers, des machines et, surtout, des humains que nous restons (tant bien que mal) à l’ère de l’IA. D’Atlas, le navigateur d’OpenAI qui rêve de nous libérer du joug de Google, à Spotify qui pose les menottes à ses intelligences musicales, tous semblent engagés dans la même course échevelée : rassurer suffisamment pour imposer leur révolution, mais sans jamais lâcher la bride sur la collecte de données. Cerise cosmique sur le gâteau numérique : même les agences spatiales sont rattrapées par le syndrome du caillou arrogant à dompter, façon Hayabusa 2, prouvant que l’envie humaine de “garder la main” n’a pas de limites – ni terrestres, ni extrêmes-orbitales.

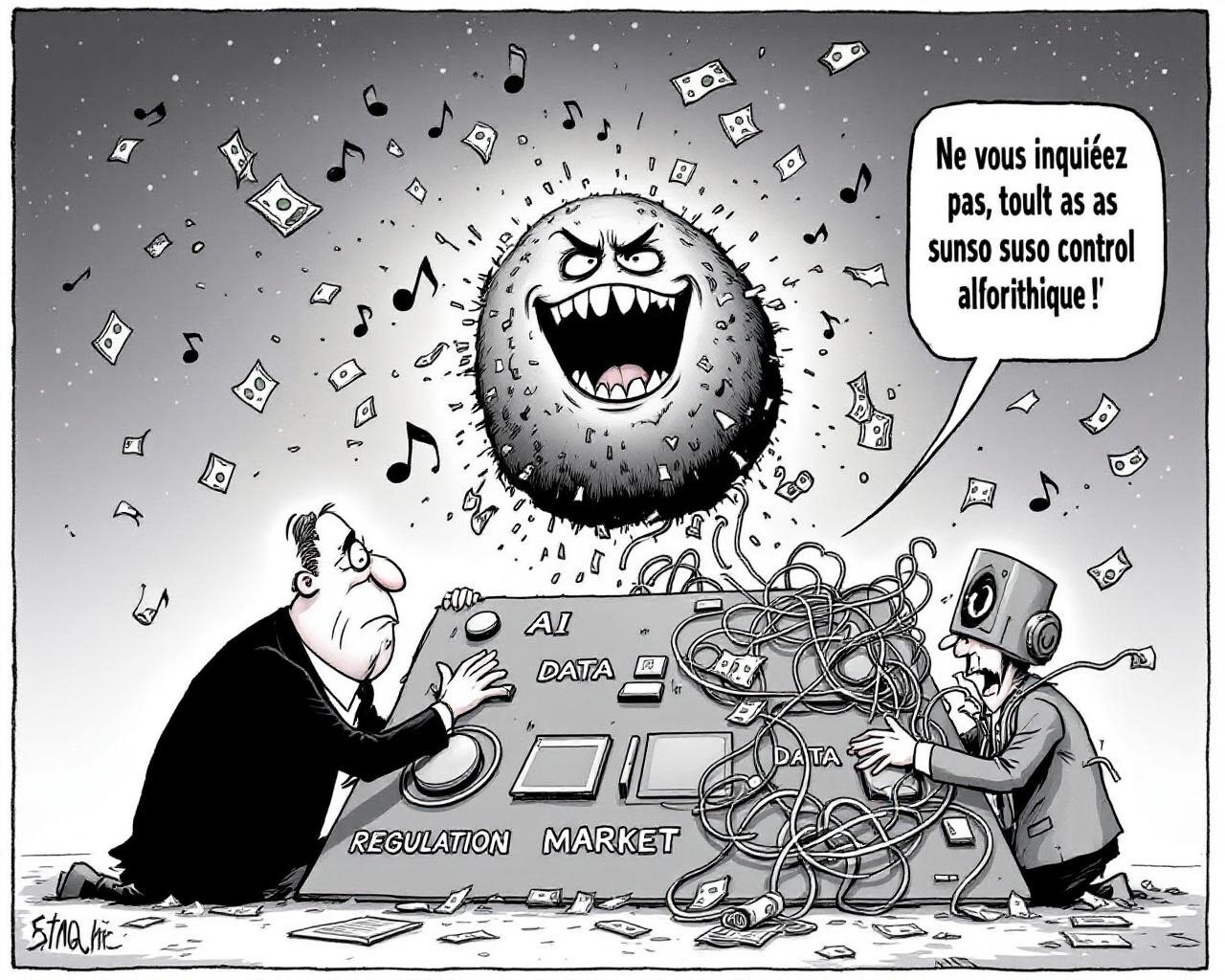

Ce qui se joue, entre navigateurs conversationnels et batailles de milliards chez Checkout.com, c’est la tentation de remplacer l’agitation chaotique des marchés ou du surf web par une pseudo-maîtrise algorithmique. Il faut voir la manière dont les agents IA en entreprise, façon Serval, rationalisent, découpent et “managerisent” les tâches, sous le regard attendri (mais suspicieux) des directions IT. D’un côté, on ambitionne de remplacer Google par le dialogue, de l’autre, on rêve d’automatiser l’humain — mais à condition qu’il reste suffisamment de checkpoints pour sauver la face si la machine s’empare trop du manche. Même la musique sur Spotify finit par se plier à la même logique : oui à l’IA, mais à condition que l’humain cadre la playlist… et l’encaisse.

Derrière ces promesses vertueuses se cache la même dynamique : “c’est pour votre bien, promis, donnez-nous tout et on vous rendra la vie plus cool (ou plus simple à monétiser)”. Quand la Californie brandit ses boucliers contre les chatbots IA toxiques pour enfants, on applaudit le texte, mais on doute de la puissance réelle du verrou. Car, pendant qu’on légifère sur le vérificateur d’âge ou l’alerte “pause pipi”, la machine apprend déjà à contourner les règles — qui surveille vraiment les surveillants ? Ce capitalisme de la matrice, où chaque faille de confiance sera monétisée ou détournée, fait étonnamment écho aux acrobaties financières de Checkout.com ou Stripe, où la “valorisation”, comme la promesse de sécurité, n’est qu’un mirage soigneusement mis en scène.

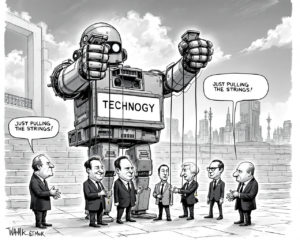

Au fond, IA, finance et régulation dansent le même bal masqué : donner l’illusion qu’on pilote, alors que tout tourne surtout de plus en plus vite.

Le véritable spin, c’est d’avoir fait de la complexité notre dernier spectacle rassurant. Les plateformes nous promettent des IA traçables et consenties — au fond, des “Alexa du dialogue social” ou des “DJ responsables”, qui swinguent sagement entre droit d’auteur et modération parentale. Mais à la première embardée, un astéroïde survolté vient rappeler à l’humanité son infinie vulnérabilité, comme dans cette mission japonaise où on s’attendait à cueillir un caillou docile… et où l’objet, minuscule, brillant, furieusement agile, défie toute logique (et toute technologie) humaine. Peut-être que la plus grande audace reste d’admettre que le chaos ne sera jamais dompté tout à fait, qu’il vaut parfois mieux apprendre à danser avec lui que d’en verrouiller chaque variable dans une feuille de calcul Excel ou une loi californienne — rappelant, au passage, le sort tout aussi incertain de nos “licornes décacornes”.

À l’heure où l’innovation se donne des airs de savant contrôle, la réalité frappe à coups de bug, d’accident ou de désillusion réglementaire. Que ce soit sur les places financières, dans le cloud, dans nos oreilles ou à la surface d’un astéroïde, la seule constante, c’est la vitesse à laquelle la machine — qu’elle soit code humain ou code algorithmique — finit toujours par échapper à ses maîtres. Le futur sera-t-il dialogué, automatisé, balisé, ou simplement plus imprévisible que jamais ? Ah, la technologie… toujours quelques tours d’avance, et jamais assez de freins.