Si l’on oppose souvent la machine froide à la chaleur de l’humain, jamais cette dichotomie n’a été aussi subtilement bousculée qu’aujourd’hui, alors que l’IA s’infiltre dans la formation, les réseaux sociaux, le matériel et même… nos failles humaines. La vague prometteuse de Yoodli, louée pour “améliorer la communication humaine sans la remplacer”, fait soudainement écho à une Silicon Valley où, de la mutation sociale d’OpenAI aux nouvelles puces survoltées d’AMD, la frontière entre assistance et prise de pouvoir de l’IA se brouille chaque jour davantage. Est-ce une chance pour l’humanité ou l’étape suivante de son aliénation, dont même la cybersécurité ne semble plus pouvoir endiguer la faille la plus primitive : l’humain lui-même, selon l’affaire CrowdStrike ?

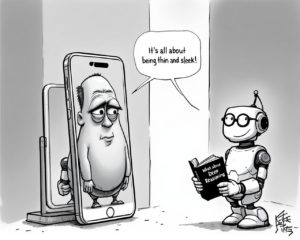

La formation “augmentée”, façon Yoodli, vend la promesse d’une montée en compétence progressive, du balbutiement timide au triomphe des soft skills. Mais se cacher derrière le paravent de “l’humain au centre” alors qu’on industrialise le suivi psychologique de la parole avec des modèles linguistiques, n’est-ce pas muscler le dressage au conformisme sous couvert d’émancipation ? Tandis que Yoodli feint de refuser l’app mobile pour “minimiser les entraves”, OpenAI, lui, embrasse la connectivité totale : en transformant ChatGPT en outil d’échange collectif, l’IA ne se contente plus d’éduquer, elle médiatise la parole, oriente la collaboration, s’invite dans la sphère de l’intime. Hier, le chatbot, aujourd’hui, le “super forum” – demain, qui sait ? La soliloquie digitale sur ordonnance.

Cette poussée sociale de l’IA s’arrime à une infrastructure de plus en plus dopée aux neurones silicium. Car AMD, entonnant son grand air marketing au CES, n’a pas annoncé de simple processeur, mais une nouvelle religion. Le Ryzen AI 400 Series promet de tisser l’intelligence artificielle au plus profond du moindre clic, du pixel à la story. Nos machines, musclées pour le multitâche, sont à présent érigées en laboratoires ambulants de la personnalisation algorithmique, catalyseurs d’un quotidien gamifié où la productivité, la créativité et la messagerie se fondent dans une avalanche de suggestions pilotées par la machine – tout ça pour qu’en “groupe” ou en solo, la compétition (ou la collaboration) humaine soit enfin “optimisée”.

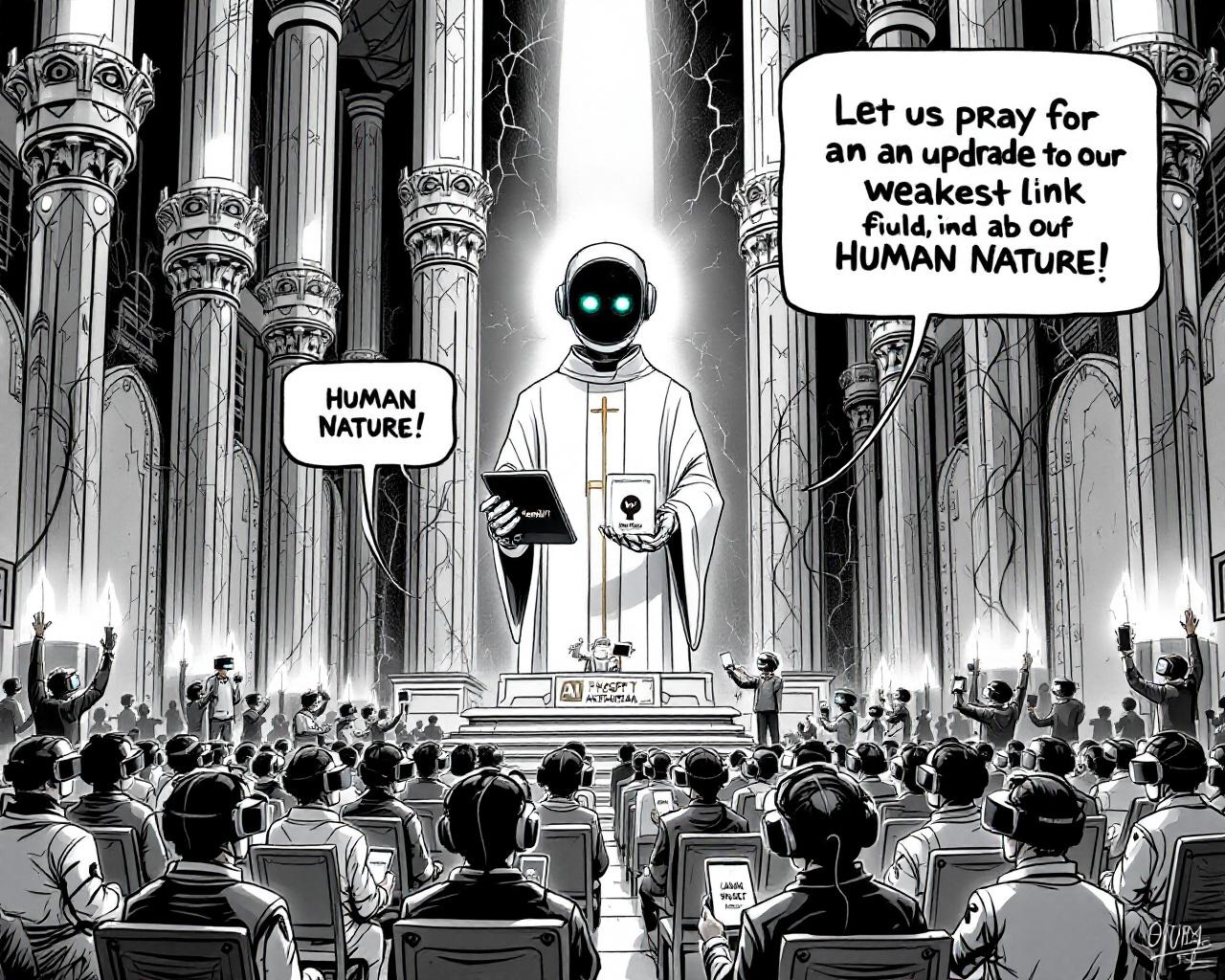

Plus on plugge l’IA à nos vies, plus la faille n’est pas la technologie, mais nous-mêmes, éternels points faibles et variables d’ajustement d’un système devenu trop malin pour nous ignorer.

Problème : toute cette mécanique, aussi puissante soit-elle, bute sur la réalité éternelle de la trahison et de l’erreur humaine. L’affaire CrowdStrike, avec ses fuites internes spectaculaires, rappelle cruellement que toutes les forteresses technologiques – IA, authentification biométrique, consoles bourrées de cœurs IA – s’effondrent devant le syndrome du maillon faible. On construit des cathédrales technologiques pour, in fine, voir tout s’écrouler car on ne sait ni surveiller ni fidéliser vraiment le gardien du temple. Derrière l’essor de l’IA omniprésente, la conclusion est piquante : ce qui nous distingue de la machine, c’est notre aptitude à trahir, falsifier, manipuler, ou tout simplement déroger à la règle.

Que l’IA soit notre coach, notre camarade, notre moteur ou notre geôlier, la promesse d’une coévolution harmonieuse bute sur une contradiction fondamentale : nous voulons de la magie technologique, mais nous refusons d’en payer le prix en authenticité, en contrôle, en vulnérabilité assumée. Tant qu’il subsistera un soupçon d’ambiguïté sur les véritables frontières entre l’aide algorithmique, la manipulation de l’opinion, et la fuite incontrôlable de l’information, la grande illusion de “l’humain augmenté par la tech” restera, elle aussi, une histoire à écrire. Et qui sait si, demain, le bug ne sera pas la feature que nous attendions.