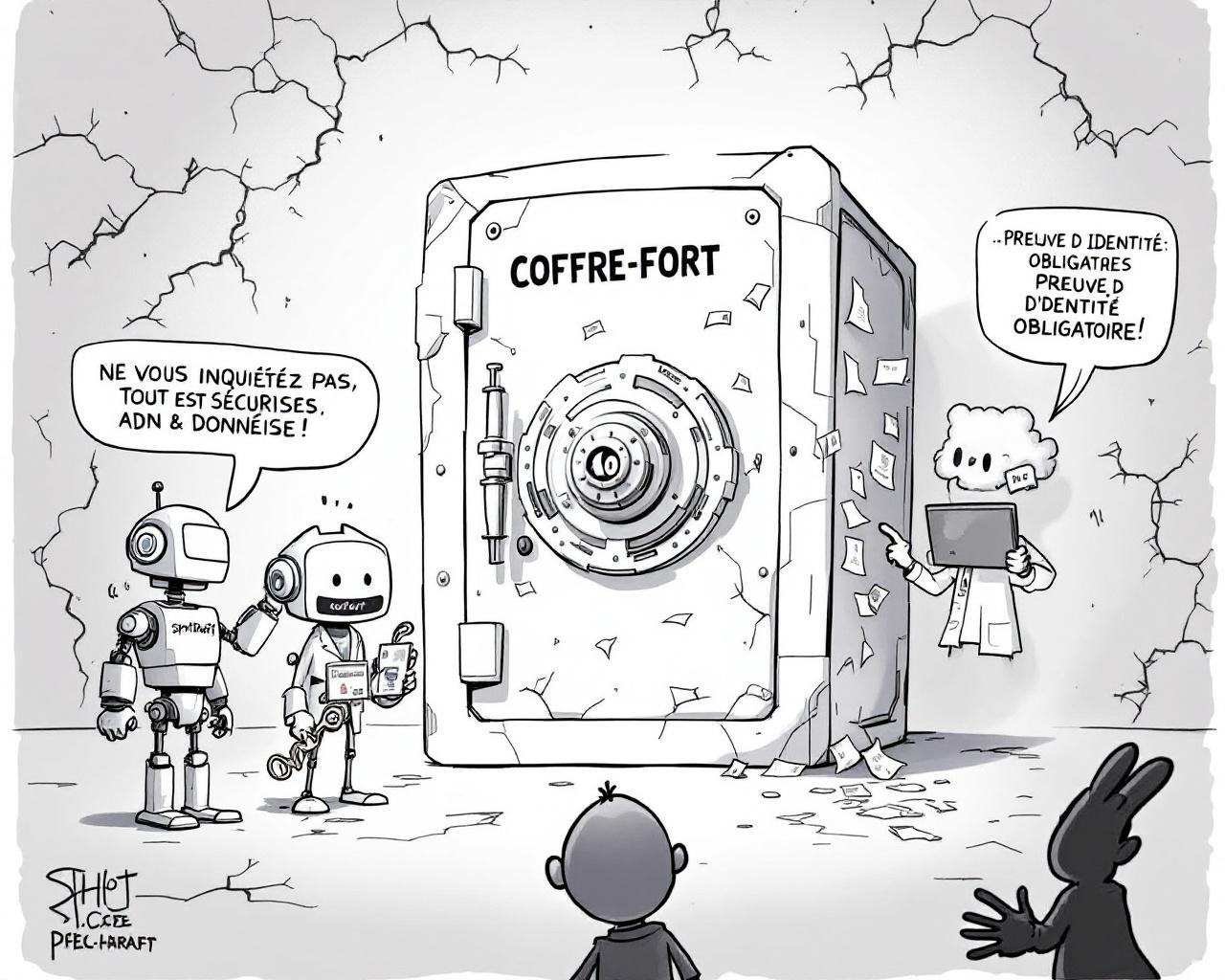

À l’heure où chaque start-up de l’IA déploie sa bannière sur le champ de bataille de la productivité et de la sécurité, la frontière entre confidentialités promises et illusions technologiques semble s’effriter plus vite qu’une NDA mal cryptée. Pourquoi choisir entre un cloud omniscient et une IA « on-device » qui promet de faire tourner la ronde des contrats sans qu’un octet ne s’évade ? Pendant que SpotDraft s’enthousiasme pour la « revue contractuelle hors cloud », Discord, dans une danse inverse, réclame à ses ouailles de prouver leur majorité pour conquérir le royaume des discussions cryptées. L’un protège la data des indiscrétions des serveurs, l’autre l’innocence (supposée) des ados contre les affres du web. Deux interprétations contemporaines et pathétiques de la phrase : « Sécurisez vos arrières. »

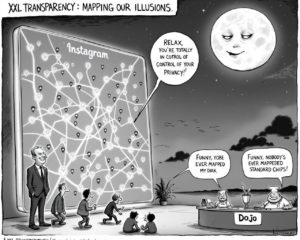

Car si l’ultra-sécurité passe par l’IA locale, la gouvernance et la légitimité passent, sur Discord, par la faciale et l’intronisation « adulte » documentée. On scanne sa carte d’identité, on se force à sourire au selfie : la sécurité est peut-être un droit, mais la vie privée devient vite un lobby oublié dans les serveurs d’authentification. L’historique du cloud et les prouesses du on-device convergent alors dans une ironie sublime : les documents les plus sensibles (contrats ? identités ?) transitent dans les deux cas vers des infrastructures faussement « personnelles ». De quoi consoler les corporates angoissés qui refusent le cloud à défaut de refuser l’invasion algorithmique : l’enjeu aujourd’hui n’est plus la machine, mais ce qu’humains, législateurs et éditeurs acceptent sciemment d’y abandonner.

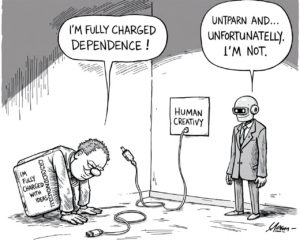

Mais le bal des illusions ne s’arrête pas aux frontières du juridique. Voilà qu’Anthropic propulse ses IA à tutoyer les 30%, puis 45% de performance sur des tâches dites « intellectuelles ». Panique chez les professions du cerveau, qui découvrent que la singularité menace d’abord les jobs « intelligents », pas les cols bleus. Les modèles génératifs bousculent la pharma, à l’image de Converge Bio qui promet de concevoir demain ses médicaments dans le nuage, plutôt que sur la paillasse de labo. Sécurité des données ? Les séquences ADN vadrouillent de Boston à Tel-Aviv, les prototypes d’anticorps se font liker sur Slack avant même d’être brevetés. Les « laboratoires génératifs » sont-ils plus sûrs que les serveurs Discord ? À débattre…

À force de protéger la jeunesse du web et l’innovation du secret industriel, on finit par échanger notre intimité contre une simulation sécurisée de nous-mêmes.

Derrière la frénésie de l’innovation, une ébullition paradoxale : la promesse de l’efficacité algorithmique n’avance que dans le brouillard des compromis. L’IA sur-puissante augure d’une réinvention des professions, mais chaque nouvelle barrière pour filtrer l’utilisateur, le de-doper, le catégoriser, accentue la marginalisation de l’humain derrière une série de protocoles abscons et de faux positifs. Pendant que la pharma rêve de raccourcir la R&D via le machine learning, Discord bêle sa volonté de protéger les adolescents en demandant toujours plus de preuves, et SpotDraft vend l’illusion d’un monde où la confidentialité serait enfin totale… pour mieux faire oublier toutes les brèches ouvertes ailleurs.

Reste à savoir si notre société connectée préfère le mirage d’un contrôle absolu – médicamenteux, professionnel, identitaire – ou si elle acceptera de composer, humblement, avec l’imperfection. Car à vouloir protéger tout le monde de tout, on ne crée parfois qu’un nouveau panoptique, où l’utilisateur, l’avocat en reconversion ou le chercheur en biotechnologie ne pourra plus jamais se faufiler dans le non dit, ni innover sans déclarer la couleur. Qui, vraiment, possède la clé de notre data ? Et, accessoirement, qui mettra la première faille au coffre-fort 4.0 ?