Si l’on voulait résumer la semaine tech d’un soupir : tout court toujours, tout s’accélère, mais pour finir, même le cloud souffle. Google peaufine le moindre « heu » dans la dictée vocale pendant que Snap lorgne sur nos visages pour y coller virtuellement encore plus de lunettes connectées, Nvidia offre l’autoroute open source à l’autonomie automobile, et Synthesia essaye de transformer tout ce joli monde en agents d’apprentissage plus rentables que jamais — le tout au milieu des data centers qui chauffent, des IA qui apprennent, et des Indiens qui veulent que chaque bit pondu par une intelligence soit aussi collectivement monnayé qu’un tube de Bollywood. La technologie avance partout, mais la question demeure : jusqu’où et pour qui ?

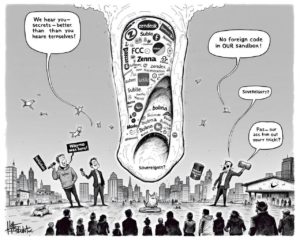

Le dialogue homme-machine a rarement été aussi subtil, ou plutôt aussi direct, entre le vocal d’Google qui promet de transformer nos paroles en texte sans le pathétique bégaiement de l’ancien monde, la formation vidéo d’Synthesia qui veut faire de nous tous des agents IA érudits, et Snap qui retente la séduction du réel augmenté dans le sillage glissant de Specs, avec l’aide siliconée de Qualcomm. Mais ce jeu de miroirs interactifs, entre paroles lissées et images générées, ne fait-t-il pas finalement de nous les cobayes consentants d’une expérimentation mondiale où nos gestes, visages, voix et bugs deviennent la matière première ultime du soft power algorithmique?

Derrière la parade auto-congratulatoire des nouvelles interfaces — dictée intelligente, lunettes AR, flotte sous-marine robotisée ou voitures à la raison artificielle (Nvidia Alpamayo) — l’intelligence tente de s’organiser comme une grande armée de clones : chaque secteur rêve son agent, chaque entreprise soupire son jumeau IA, chaque marché impose son standard. Même la mer envoie ses IA sous-marines (Skana Robotics) pour parler discret — franchement, qui aurait cru que l’ère de l’explicabilité algorithmique s’écrirait à coups d’algorithmes « vieillots » dans les profondeurs?

Des dictées vocales sans hésitation aux data centers assoiffés, l’IA grignote nos usages, mais qui grignote l’IA ?

Tous rêvent d’autonomie, de sécurité et d’efficacité, mais tous finissent branchés au même problème : cette IA dévore du data center comme d’autres engloutissent des chips, et c’est la planète (et nos factures) qui s’enflamment. Faut-il s’indigner à la manière des 230 associations écologistes qui dénoncent la voracité électrique de la bête (Data center : L’énergie du désespoir) ou s’en remettre à la foi inébranlable du progrès qui trouvera bien une piste pour refroidir tout ça avant la panne générale ? Au fond, la vraie disruption vient peut-être de l’Inde, qui propose de taxer l’imaginaire des machines pour le redistribuer aux créateurs (l’offensive indienne) pendant que la Silicon Valley rêve encore du « fair use » éternel.

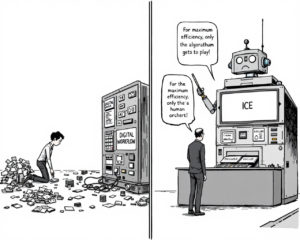

À force de tout confier à des agents numériques, qui personnaliseront notre orthographe, régleront nos bugs, formeront nos remplaçants, contrôleront nos ports, et rangeront nos mémoires, reste-t-il un espace pour une décision véritablement humaine ? Peut-être qu’à la fin, les seuls à posséder un vrai libre arbitre seront… les serveurs, fatigués d’alimenter la croissance éternelle. Mais quand viendra l’IA pour conduire nos voitures, écrire nos mails, rétribuer nos rêves et protester contre elle-même, il ne restera plus qu’à leur demander si elles veulent, elles, continuer à avancer. Ou bien s’arrêter, juste pour rire. Et ça, ce serait révolutionnaire.