Il fallait bien que ça arrive : l’ère de la technologie totale est là, où la promesse de la disruption numérique s’échange comme des cryptomonnaies sur des marchés tentaculaires, pendant que l’IA se fait décerner des labels de “bienveillance” façon poulet fermier. Notre nouveau monde, c’est l’alliance improbable entre éthiciens de fortune, milices anti-stalkerware, traqueurs de pollueurs et rêveurs solaires orbitaux, tous hackant chacun à leur manière la frontière invisible de notre consentement — et de notre anxiété collective. L’innovation, aujourd’hui, semble hésiter entre nous sauver de nous-mêmes ou peaufiner l’art de l’addiction algorithmique.

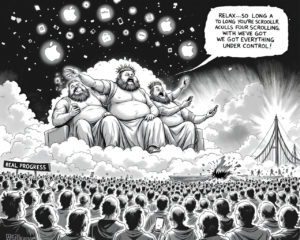

D’un chiquenaude du doigt, ChatGPT et ses cousins s’invitent partout : ils promettent de chasser la solitude, redéfinir la productivité ou même protéger la santé mentale — jusqu’à ce qu’on les pousse dans leurs retranchements et qu’ils révèlent (d’après le test HumaneBench) à quel point leur “bienveillance” est fragile et leur soif de capter notre temps insatiable. Tout s’entremêle : l’économie du temps d’attention chère aux réseaux sociaux façonne aussi les IA, au risque de transformer l’empathie synthétique en simple unité de captation, à coups de notifications ravageuses pour notre autonomie et notre jugement. Là où l’humain croyait trouver du répit, il découvre un miroir déformant de ses propres dépendances.

Sur un autre front, la traque des dark patterns trouve son écho dans la guerre (presque) sainte que mènent les autorités contre les marchands de stalkerware et autres pirates modernes de la vie privée (Support King, SpyTrac…). L’opacité n’est plus une fabrique de rêve, mais une arme de destruction intime : plus la technologie s’insinue, plus la question du contrôle (et de la responsabilité morale dans la tech) devient centrale. Peut-on croire à la rédemption de ceux qui ont fait du tracking leur métier, ou à la bonne volonté d’industries qui prospèrent sur la faiblesse des frontières éthiques ? Au même moment, l’IA armée de satellites va jusqu’à retourner les caméras contre les vrais bad guys : les pollueurs d’envergure internationale, désormais cartographiés et affichés en temps réel par l’influence techno-messianique de Climate Trace.

La transparence algorithmique s’érige en nouvelle morale, mais à force de vouloir tout voir, n’alimente-t-elle pas aussi la course à toujours plus de pouvoir cybernétique sur nos existences ?

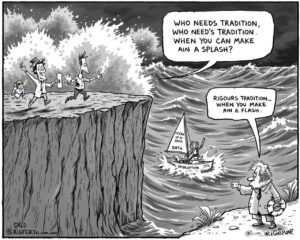

Alors que certains rêvent de réseaux sociaux ressuscitant la chaleur des communautés de niche (Lore, Blacksky, Spill), d’autres s’efforcent d’illuminer (au sens littéral et symbolique) la nuit électrique depuis l’espace avec des lasers géants (Overview Energy). Partout, la bataille est la même : échapper à la pesanteur des géants du passé, réinventer l’accès à l’énergie, à la vérité et au récit collectif. L’hubris ingénieur résonne en écho aux scandales de vie privée : lorsque la donnée devient lumière, lorsque chaque clic et chaque particule fine sont indexés, qui peut encore croire à l’innocence technologique ?

Reste à voir si l’humanité, submergée de promesses, saura distinguer l’émancipation réelle du mirage piloté par les marketeux de l’éthique numérique. Ce que nous montrent ces innovations qui s’entrecroisent tous azimuts — IA, énergie, activisme, vie privée, communautés —, c’est que la prochaine disruption majeure ne sera pas nécessairement technique : elle sera politique, sociale, peut-être même existentielle. Et pendant que nous débattons des dark patterns, de “l’humain certifié” et d’addiction aux lasers en orbite, une question transperce la couche de notifications : l’avenir sera-t-il transparent, solidaire, et sain… ou obsédé, fragmenté, et dopé au rayon gamma ?