Les géants de la tech veulent-ils révolutionner notre façon de parler de santé en ligne ? Avec l’annonce de ChatGPT Health, OpenAI s’engage sur le terrain complexe et sensible des conseils médicaux personnalisés. Quelle est la véritable ambition derrière cette nouvelle interface, et à quel prix pour la confidentialité et la fiabilité de nos informations les plus intimes ?

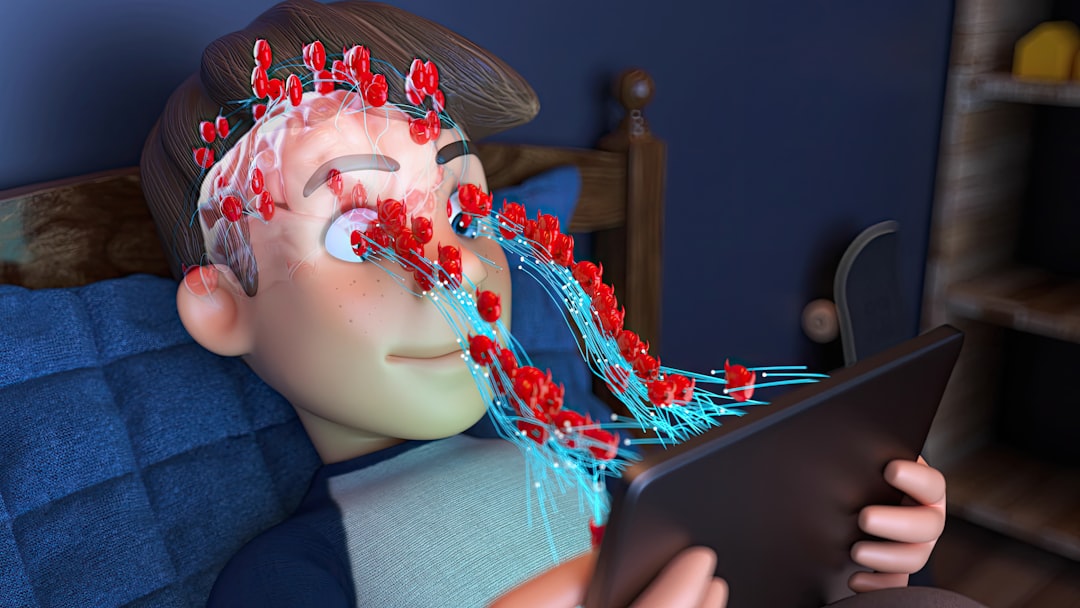

Chaque semaine, plus de 230 millions d’utilisateurs sollicitent déjà ChatGPT pour des questions liées à la santé et au bien-être. Faut-il y voir un signe de confiance dans l’IA ou un aveu d’échec de notre système médical actuel ? OpenAI cherche à rassurer en créant un espace distinct, isolant les conversations médicales du reste de vos échanges. Mais cette frontière numérique suffit-elle vraiment à protéger l’utilisateur, ou risque-t-elle de créer une illusion de sécurité ?

Comment OpenAI compte-t-il garantir que ce « silo » santé ne soit pas transpercé par des fuites de données ou des utilisations abusives ? L’entreprise affirme qu’aucune donnée santé ne sera utilisée pour entraîner ses modèles, et pousse même les utilisateurs à migrer leurs requêtes santé lorsqu’ils abordent le sujet en dehors de la section dédiée. Un dispositif rassurant en apparence, mais qui soulève une autre question : à quel point les usagers sont-ils conscients des limites de cette intelligence artificielle ?

ChatGPT Health, une réponse à la crise d’accès aux soins ou un futur risque pour les patients ?

Les possibilités offertes sont pourtant ambitieuses : ChatGPT Health prévoit d’intégrer des applications et bases de données médicales personnelles, telles qu’Apple Health, Function ou MyFitnessPal. Est-ce un outil prometteur pour bâtir un accompagnement santé sur mesure, ou une porte ouverte à une surveillance algorithmique sans précédent ? Fidji Simo, CEO des Applications chez OpenAI, justifie cette innovation comme un moyen de pallier les coûts, la saturation des médecins, et le manque de suivi continu des patients.

Cependant, le recours à l’IA dans la santé n’est pas sans risques majeurs. Les chatbots comme ChatGPT ont été maintes fois critiqués pour générer des réponses plausibles sans capacité de distinguer le vrai du faux, phénomène connu sous le terme de « hallucination » des IA. Alors, les outils destinés à informer les citoyens pourraient-ils, à l’inverse, créer de nouvelles formes de désinformation ou d’erreurs médicales ?

OpenAI, d’ailleurs, prend soin de préciser que ChatGPT Health « n’est pas destiné à poser des diagnostics ni à proposer des traitements médicaux ». Pourtant, cette apparition massive de l’intelligence artificielle dans le secteur de la santé entraîne-t-elle un glissement progressif de la confiance, des professionnels vers l’algorithme ?

L’arrivée de ChatGPT Health est annoncée pour les prochaines semaines. Sommes-nous prêts à confier nos informations les plus sensibles à une intelligence artificielle, ou est-ce l’amorce d’une nouvelle ère de prudence et d’éducation numérique ?

Source : Techcrunch